Robots.txt फाइल म्हणजे काय? एसइओसाठी रोबोट्स फाइल लिहिण्यासाठी, सबमिट करण्यासाठी आणि पुन्हा क्रॉल करण्यासाठी आवश्यक असलेली प्रत्येक गोष्ट

आम्ही यावर एक व्यापक लेख लिहिला आहे शोध इंजिने तुमची वेबसाइट कशी शोधतात, क्रॉल करतात आणि अनुक्रमित करतात. त्या प्रक्रियेतील एक पायाभूत टप्पा आहे robots.txt फाइल, तुमची साइट क्रॉल करण्यासाठी शोध इंजिनसाठी गेटवे. शोध इंजिन ऑप्टिमायझेशनमध्ये robots.txt फाइल योग्यरित्या कशी तयार करावी हे समजून घेणे आवश्यक आहे (एसइओ).

हे सोपे पण शक्तिशाली साधन वेबमास्टर्सना शोध इंजिने त्यांच्या वेबसाइटशी कसा संवाद साधतात हे नियंत्रित करण्यात मदत करते. वेबसाइटचे कार्यक्षम अनुक्रमणिका आणि शोध इंजिन परिणामांमध्ये इष्टतम दृश्यमानता सुनिश्चित करण्यासाठी robots.txt फाइल समजून घेणे आणि त्याचा प्रभावीपणे वापर करणे आवश्यक आहे.

Robots.txt फाइल म्हणजे काय?

robots.txt फाइल ही वेबसाइटच्या मूळ निर्देशिकेत असलेली मजकूर फाइल आहे. शोध इंजिन क्रॉलर्सना साइटचे कोणते भाग क्रॉल आणि अनुक्रमित केले जावे किंवा करू नये याबद्दल मार्गदर्शन करणे हा त्याचा प्राथमिक उद्देश आहे. फाइल रोबोट्स एक्सक्लूजन प्रोटोकॉल वापरते (आरईपी), एक मानक वेबसाइट वेब क्रॉलर्स आणि इतर वेब रोबोट्सशी संवाद साधण्यासाठी वापरतात.

REP हे अधिकृत इंटरनेट मानक नाही परंतु मोठ्या शोध इंजिनांद्वारे मोठ्या प्रमाणावर स्वीकारले जाते आणि समर्थित आहे. Google, Bing आणि Yandex सारख्या प्रमुख शोध इंजिनांकडील दस्तऐवजीकरण हे स्वीकृत मानकाच्या सर्वात जवळ आहे. अधिक माहितीसाठी, भेट द्या Google चे Robots.txt तपशील शिफारसीय आहे.

Robots.txt एसइओसाठी गंभीर का आहे?

- नियंत्रित क्रॉलिंग: Robots.txt वेबसाइट मालकांना त्यांच्या साइटच्या विशिष्ट विभागांमध्ये प्रवेश करण्यापासून शोध इंजिनांना प्रतिबंधित करण्यास अनुमती देते. हे विशेषतः डुप्लिकेट सामग्री, खाजगी क्षेत्रे किंवा संवेदनशील माहिती असलेले विभाग वगळण्यासाठी उपयुक्त आहे.

- ऑप्टिमाइझ केलेले क्रॉल बजेट: शोध इंजिन प्रत्येक वेबसाइटसाठी क्रॉल बजेट, शोध इंजिन बॉट साइटवर किती पृष्ठे क्रॉल करेल याची संख्या निश्चित करतात. अप्रासंगिक किंवा कमी महत्त्वाच्या विभागांना अनुमती देऊन, robots.txt हे क्रॉल बजेट ऑप्टिमाइझ करण्यात मदत करते, अधिक महत्त्वाची पृष्ठे क्रॉल आणि अनुक्रमित आहेत याची खात्री करून.

- सुधारित वेबसाइट लोडिंग वेळ: बॉट्सला बिनमहत्त्वाच्या संसाधनांमध्ये प्रवेश करण्यापासून प्रतिबंधित करून, robots.txt सर्व्हर लोड कमी करू शकते, संभाव्यतः साइटच्या लोडिंग वेळेत सुधारणा करू शकते, SEO मधील एक महत्त्वपूर्ण घटक.

- सार्वजनिक नसलेल्या पृष्ठांची अनुक्रमणिका प्रतिबंधित करणे: हे गैर-सार्वजनिक क्षेत्रे (जसे की स्टेजिंग साइट किंवा डेव्हलपमेंट क्षेत्रे) अनुक्रमित होण्यापासून आणि शोध परिणामांमध्ये दिसण्यास मदत करते.

Robots.txt अत्यावश्यक आदेश आणि त्यांचे उपयोग

- परवानगी द्या: हा निर्देश क्रॉलर्सद्वारे साइटच्या कोणत्या पृष्ठांवर किंवा विभागांमध्ये प्रवेश केला पाहिजे हे निर्दिष्ट करण्यासाठी वापरला जातो. उदाहरणार्थ, वेबसाइटमध्ये SEO साठी विशेषत: संबंधित विभाग असल्यास, 'अनुमती द्या' कमांड ते क्रॉल केले आहे याची खात्री करू शकते.

Allow: /public/- नाकारू नका: 'अनुमती द्या' च्या उलट, ही कमांड सर्च इंजिन बॉट्सना वेबसाइटचे काही भाग क्रॉल न करण्याची सूचना देते. हे लॉगिन पृष्ठे किंवा स्क्रिप्ट फायलींसारख्या SEO मूल्य नसलेल्या पृष्ठांसाठी उपयुक्त आहे.

Disallow: /private/- वाइल्डकार्ड्स: पॅटर्न मॅचिंगसाठी वाइल्डकार्डचा वापर केला जातो. तारका (*) वर्णांच्या कोणत्याही क्रमाचे प्रतिनिधित्व करते आणि डॉलर चिन्ह ($) URL च्या शेवटी सूचित करते. हे URL च्या विस्तृत श्रेणी निर्दिष्ट करण्यासाठी उपयुक्त आहेत.

Disallow: /*.pdf$- साइटमॅप: robots.txt मध्ये साइटमॅप स्थान समाविष्ट केल्याने शोध इंजिनांना साइटवरील सर्व महत्त्वाची पृष्ठे शोधण्यात आणि क्रॉल करण्यात मदत होते. हे एसइओसाठी महत्त्वपूर्ण आहे कारण ते साइटच्या जलद आणि अधिक संपूर्ण अनुक्रमणिकेत मदत करते.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt अतिरिक्त आदेश आणि त्यांचे उपयोग

- वापरकर्ता एजंट: नियम कोणत्या क्रॉलरला लागू होतो ते निर्दिष्ट करा. 'वापरकर्ता-एजंट: *' हा नियम सर्व क्रॉलर्सना लागू होतो. उदाहरण:

User-agent: Googlebot- Noindex: मानक robots.txt प्रोटोकॉलचा भाग नसताना, काही शोध इंजिने समजतात Noindex निर्दिष्ट URL अनुक्रमित न करण्याच्या सूचना म्हणून robots.txt मध्ये निर्देश.

Noindex: /non-public-page/- क्रॉल-विलंब: हा आदेश क्रॉलर्सना तुमच्या सर्व्हरवरील हिट दरम्यान ठराविक वेळ प्रतीक्षा करण्यास सांगतो, सर्व्हर लोड समस्या असलेल्या साइटसाठी उपयुक्त आहे.

Crawl-delay: 10तुमच्या Robots.txt फाइलची चाचणी कशी करावी

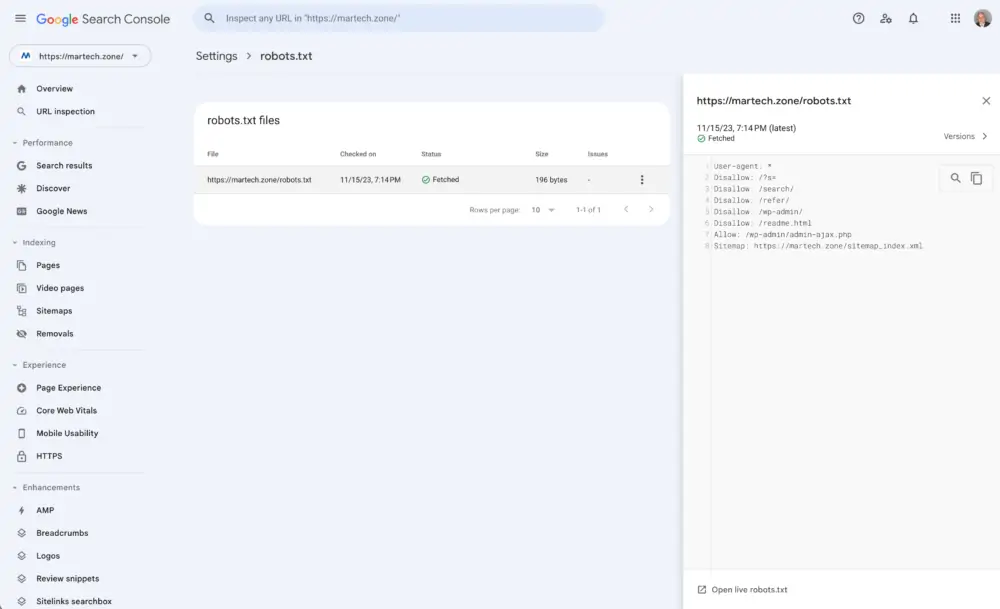

जरी ते दफन केले गेले आहे Google शोध कन्सोल, शोध कन्सोल एक robots.txt फाइल टेस्टर ऑफर करते.

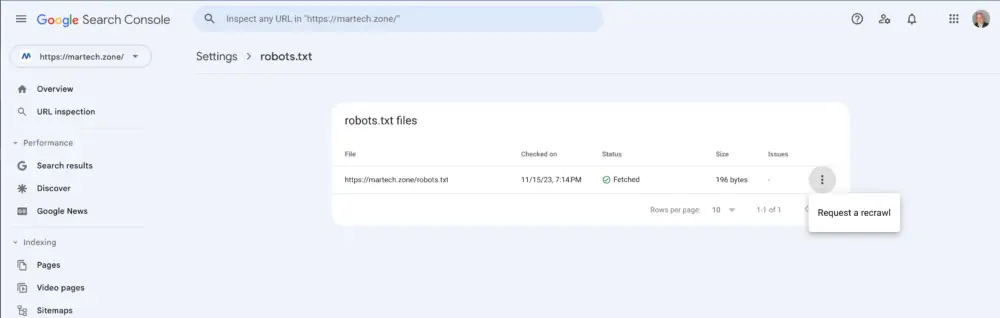

तुम्ही तुमची Robots.txt फाईल उजवीकडे असलेल्या तीन बिंदूंवर क्लिक करून आणि निवडून देखील पुन्हा सबमिट करू शकता. पुन्हा क्रॉल करण्याची विनंती करा.

तुमच्या Robots.txt फाइलची चाचणी करा किंवा पुन्हा सबमिट करा

AI बॉट्स नियंत्रित करण्यासाठी Robots.txt फाइल वापरली जाऊ शकते का?

robots.txt फाइल हे परिभाषित करण्यासाठी वापरले जाऊ शकते AI वेब क्रॉलर्स आणि इतर स्वयंचलित बॉट्ससह बॉट्स तुमच्या साइटवरील सामग्री क्रॉल किंवा वापरू शकतात. फाइल या बॉट्सचे मार्गदर्शन करते, ते सूचित करते की वेबसाइटच्या कोणत्या भागांमध्ये प्रवेश करण्यास परवानगी आहे किंवा त्यांना परवानगी नाही. AI बॉट्सच्या वर्तनावर नियंत्रण ठेवणारी robots.txt ची परिणामकारकता अनेक घटकांवर अवलंबून असते:

- प्रोटोकॉलचे पालन: सर्वाधिक प्रतिष्ठित शोध इंजिन क्रॉलर्स आणि इतर अनेक AI बॉट्स सेट केलेल्या नियमांचा आदर करतात

robots.txt. तथापि, हे लक्षात घेणे महत्त्वाचे आहे की फाइल ही अंमलबजावणी करण्यायोग्य निर्बंधापेक्षा विनंती आहे. बॉट्स या विनंत्यांकडे दुर्लक्ष करू शकतात, विशेषत: ज्या कमी निष्काळजी संस्थांद्वारे चालवल्या जातात. - निर्देशांची विशिष्टता: तुम्ही वेगवेगळ्या बॉट्ससाठी वेगवेगळ्या सूचना निर्दिष्ट करू शकता. उदाहरणार्थ, इतरांना परवानगी न देता तुम्ही विशिष्ट AI बॉट्सना तुमची साइट क्रॉल करण्याची अनुमती देऊ शकता. हे वापरून केले जाते

User-agentमध्ये निर्देशrobots.txtवरील फाइल उदाहरण. उदाहरणार्थ,User-agent: GooglebotGoogle च्या क्रॉलरसाठी निर्देश निर्दिष्ट करेल, तरUser-agent: *सर्व बॉट्सना लागू होईल. - मर्यादा: तर

robots.txtबॉट्सला निर्दिष्ट सामग्री क्रॉल करण्यापासून प्रतिबंधित करू शकते; जर त्यांना आधीच माहित असेल तर ते त्यांच्यापासून सामग्री लपवत नाही URL. याव्यतिरिक्त, सामग्री एकदा क्रॉल केल्यानंतर त्याचा वापर प्रतिबंधित करण्याचे कोणतेही साधन प्रदान करत नाही. सामग्री संरक्षण किंवा विशिष्ट वापर प्रतिबंध आवश्यक असल्यास, पासवर्ड संरक्षण किंवा अधिक अत्याधुनिक प्रवेश नियंत्रण यंत्रणा यासारख्या इतर पद्धती आवश्यक असू शकतात. - बॉट्सचे प्रकार: सर्व AI बॉट्स शोध इंजिनशी संबंधित नाहीत. विविध बॉट्स वेगवेगळ्या उद्देशांसाठी वापरले जातात (उदा. डेटा एकत्रीकरण, विश्लेषण, सामग्री स्क्रॅपिंग). robots.txt फाइल या विविध प्रकारच्या बॉट्ससाठी प्रवेश व्यवस्थापित करण्यासाठी देखील वापरली जाऊ शकते, जोपर्यंत ते REP चे पालन करतात.

अगोदर निर्देश केलेल्या बाबीसंबंधी बोलताना robots.txt फाईल हे एआय बॉट्सद्वारे साइट सामग्रीच्या क्रॉलिंग आणि वापराबाबत तुमची प्राधान्ये सूचित करण्यासाठी एक प्रभावी साधन असू शकते. तथापि, त्याची क्षमता कठोर प्रवेश नियंत्रणाची अंमलबजावणी करण्याऐवजी मार्गदर्शक तत्त्वे प्रदान करण्यापुरती मर्यादित आहे आणि त्याची परिणामकारकता रोबोट्स एक्सक्लूजन प्रोटोकॉलच्या बॉट्सच्या अनुपालनावर अवलंबून आहे.

robots.txt फाइल एसइओ शस्त्रागारातील एक लहान पण शक्तिशाली साधन आहे. जेव्हा ते योग्यरित्या वापरले जाते तेव्हा वेबसाइटची दृश्यमानता आणि शोध इंजिन कार्यक्षमतेवर लक्षणीय परिणाम करू शकते. साइटचे कोणते भाग क्रॉल आणि इंडेक्स केले आहेत हे नियंत्रित करून, वेबमास्टर त्यांच्या एसइओ प्रयत्न आणि वेबसाइट कार्यप्रदर्शन सुधारून, त्यांची सर्वात मौल्यवान सामग्री हायलाइट केल्याची खात्री करू शकतात.